Dieser Beitrag ist Teil von „Periscopio“, dem Linkedin-Newsletter, der jede Woche über zukünftige Zukunftsthemen informiert und vorab auf der LinkedIn-Plattform veröffentlicht wird. Wenn Sie es abonnieren und in der Vorschau anzeigen möchten, finden Sie alles hier.

Liegt es an mir oder nehmen die Inhalte im Netz exponentiell zu? Es ist eine rhetorische Frage: Sie wissen, wovon ich spreche, jeden Tag werden wir von mehr und mehr Posts, Warnungen, Benachrichtigungen (aber entfernen Sie NICHT die von Futuroprossimo!) aufgefordert. Die riesige Menge an Inhalten, die unsere Aufmerksamkeit erfordern, nagt an immer mehr Teilen unseres Gehirns.

Und heute stehen wir am Vorabend einer dramatischen Wende. Ein Tsunami, der den Namen trägt künstliche Intelligenz.

Wissenschaftler nennen sie synthetische Medien – Medien, die vollständig von künstlicher Intelligenz geschaffen wurden. Aus Leidenschaft (der Blog, den Sie gerade besuchen) und aus beruflichen Gründen (ich bin Werbetreibender) behalte ich diese Inhaltserstellungsroboter im Auge. Von der Zeit in den Labors bis heute, die eine Art öffentlich zugänglicher Test sind, manchmal schon auf dem Markt.

Texte und sogar Bilder

In den letzten Monaten habe ich ausführlich über OpenAI gesprochen und seiner sprachlichen Modelle: Algorithmen, die die menschliche Sprache interpretieren. Um was zu tun? Ach alles. Um es zum Beispiel zu transkribieren. Entweder um es zu übersetzen oder um es auf der Grundlage eines ständig wachsenden Datensatzes anders zu schreiben. Oder vielleicht zu zeichnen, was sie verstehen.

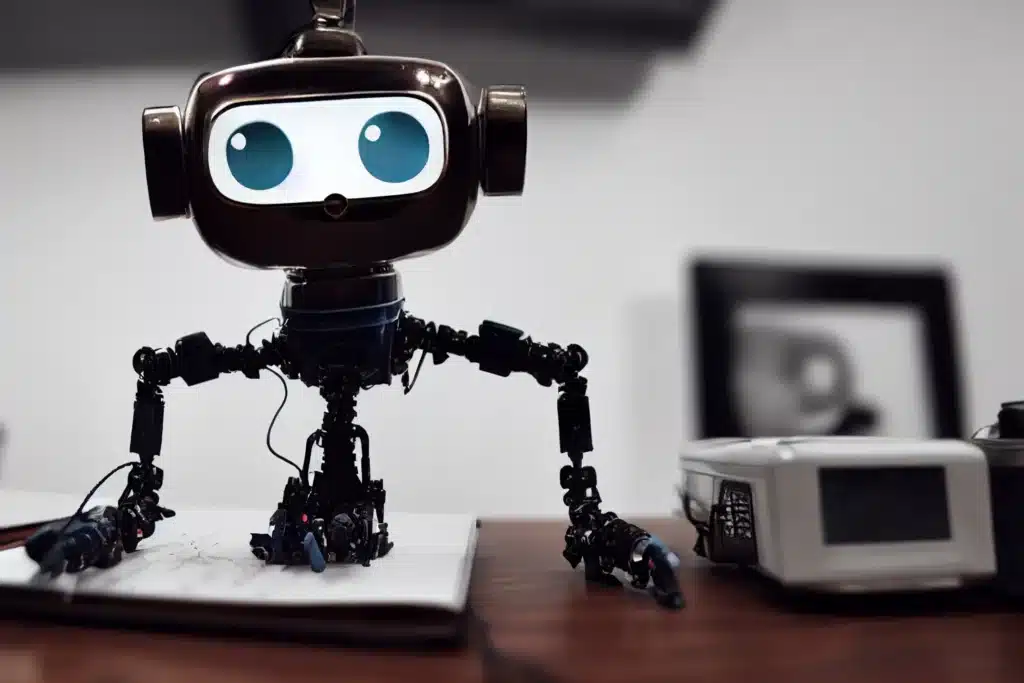

Dafür hat OpenAI die neuesten Versionen von veröffentlicht VON-2 e GPT-3 zur Öffentlichkeit. DALLE erstellt Bilder mit einfachen Texteingaben und GPT-3 schreibt in ganzen Absätzen. Für die Videos, die wir vorbereiten, werde ich es Ihnen in den kommenden Wochen sagen, aber in der Zwischenzeit können Sie es hier ausprobieren. Ich würde hinzufügen MidjourneyAI, die ich auch anfange beruflich zu nutzen (und mit der ich die Bilder zu diesem Artikel erstellt habe). Sie vervollständigen das Bild Stable Diffusion und eine Handvoll anderer KIs.

KI-Inhalte: Wir sind bereits am Werk

Es gibt bereits Bereiche, in denen KI selbst Inhalte und Nachrichten schreibt, die für die Öffentlichkeit veröffentlicht werden. Zum Miami HeraldBeispielsweise schreibt AI lokale Immobiliengeschichten. Ebenfalls Reuters beschäftigt sich mit Neuigkeiten (im Deepfake).

Es kostet eine künstliche Intelligenz praktisch nichts, tausend Versionen einer Geschichte mit den gleichen grundlegenden Fakten zu erstellen und sie dann damit zu testen. der GAN (im Gegensatz zu generativen Netzwerken), um die besten Versionen zu erstellen, die den Menschen gefallen werden.

Und das ist nicht alles. Der Text einer Geschichte kann in Sprache (sogar in einen Podcast mit synthetischer oder geklonter Stimme, ohne menschliches Zutun produziert) oder in Video umgewandelt werden digitale Menschen Informationen präsentieren. Kein Fleisch, keine Knochen.

Verstehen Sie, was uns erwartet? Meine Damen und Herren, willkommen im Zeitalter der digitalen Überlastung.

Lassen Sie uns eine Definition finden

Digital Overload ist ein Begriff, der verwendet wird, um das Gefühl zu beschreiben, von der riesigen Menge an Informationen, die online verfügbar sind, überwältigt zu werden. Eine Art „Überlauf“, der durch den gleichzeitigen Konsum von zu vielen Inhalten entsteht.

Es wäre schon ein riesiger Schaden, wenn alle Informationen, die eine KI generieren kann, korrekt wären. Und das sind sie nicht. Informationen (oder Interpolation von Informationen) einer Maschine zu überlassen, ist ein Chaos, da KI mit derselben Fähigkeit echte Nachrichten schreiben kann. was für fakenews.

Es ist nicht trivial und wird es auch nicht sein, diese Content-Lawine einzudämmen (Google er sagt, er will es versuchen, aber wie soll er das machen? Im Moment halte ich es für unmöglich).

Und was wäre, wenn der Mehrwert, für den die Menschen bereit sind zu zahlen, ein Foto oder ein schönes Stück (um Himmels willen sogar unvollkommen) wäre, das vollständig von Menschen gemacht wurde?

Mal sehen: Das Problem sind wie immer nicht die Werkzeuge, sondern wer sie einsetzt und wie sie sie einsetzt. Schließlich könnte derselbe Artikel von einer KI geschrieben worden sein, oder?

Oder auch nicht.