Was kann ein ausdrucksloses Gesicht über Ihre politische Ausrichtung verraten? Laut einer aktuellen Studie, die künstliche Intelligenz nutzte, um die politische Ausrichtung anhand von Gesichtsfotos vorherzusagen, ist das viel mehr, als Sie sich vielleicht vorstellen können. Selbst unter Berücksichtigung von Variablen wie Alter, Geschlecht und ethnischer Zugehörigkeit waren Gesichtserkennungsalgorithmen in der Lage, politische Überzeugungen mit einer Genauigkeit zu erraten, die mit der von Menschen vergleichbar ist. Doch welche Auswirkungen hat diese Entdeckung auf unsere Privatsphäre im digitalen Zeitalter?

Gesichtserkennung: das Gute und das Schlechte

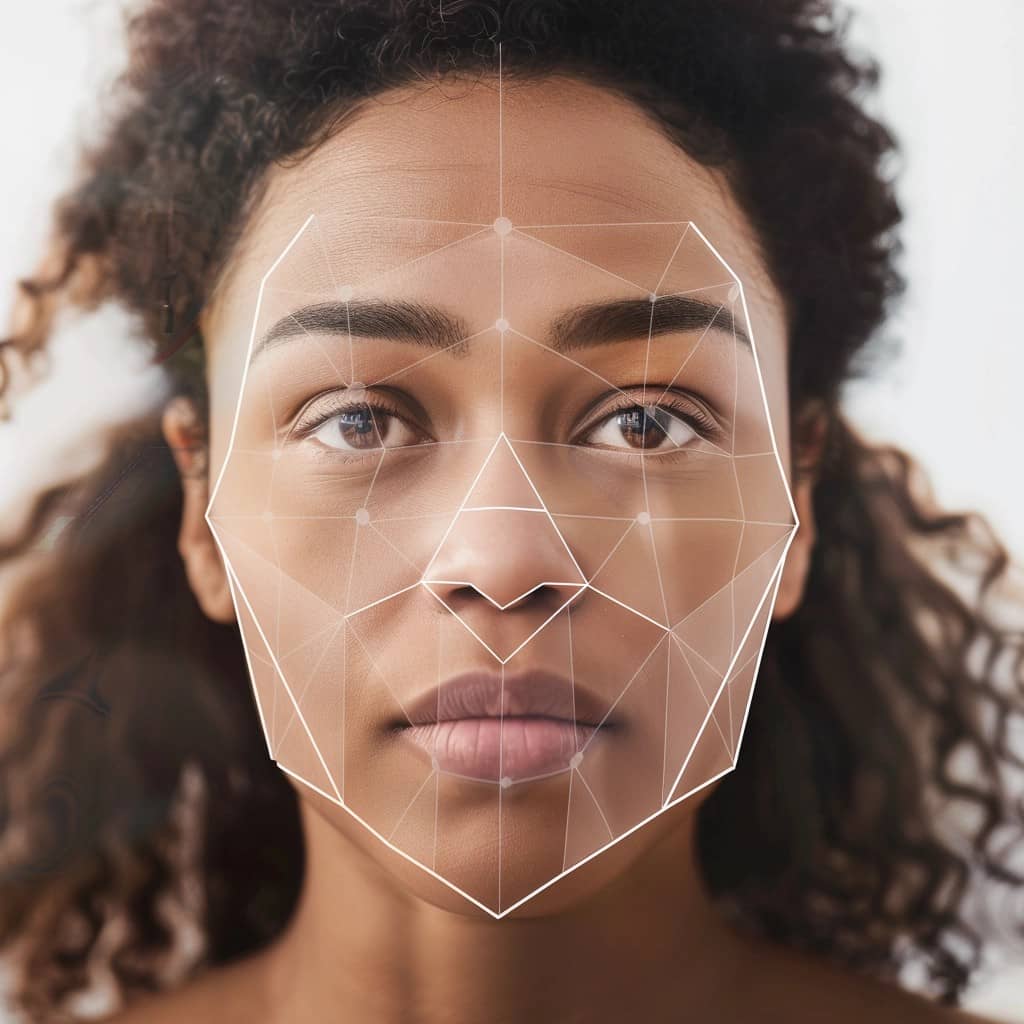

Il Gesichtserkennung ist eine Form der künstlichen Intelligenz, die Personen identifiziert und verifiziert, indem sie Muster anhand ihrer Gesichtsmerkmale analysiert. Im Wesentlichen nutzt die Technologie Algorithmen, um Gesichter in Bildern oder Videos zu erkennen. Anschließend messen Sie verschiedene Aspekte des Gesichts, wie den Abstand zwischen den Augen, die Form des Kiefers und die Kontur der Wangenknochen.

Diese Messungen werden in eine mathematische Formel umgewandelt, eine „Gesichtssignatur“, das mit einer Datenbank bekannter Gesichter verglichen werden kann, um eine Übereinstimmung zu finden, oder in verschiedenen Anwendungen verwendet werden kann, von Sicherheitssystemen über das Entsperren von Telefonen bis hin zum Markieren von Freunden in sozialen Medien.

Mit dem zunehmenden Einsatz von Gesichtserkennungstechnologien sowohl im öffentlichen als auch im privaten Sektor steigt die Möglichkeit, dass diese Tools für Zwecke eingesetzt werden, die über die einfache Identifizierung hinausgehen, beispielsweise zur Vorhersage persönlicher Eigenschaften. Zum Beispiel, und das ist der Fall, politische Orientierung.

Politische Orientierung vorhersagen: Die Studie

In ihrer neuen Studie, die in der Zeitschrift veröffentlicht wurde Amerikanischer Psychologe (Ich verlinke es hier), Forscher unter der Leitung von Michal Kosinski, außerordentlicher Professor für Organisationsverhalten an der Stanford University, folgte einem bestimmten Beispiel. Das Ziel? Isolierung des alleinigen Einflusses von Gesichtsmerkmalen auf die Vorhersage der politischen Orientierung. Die Arbeit konzentrierte sich auf Variablen wie Ausdruck und Kopforientierung.

Um dies zu tun, Sie rekrutierten 591 Teilnehmer von einer großen Privatuniversität und machten ihre Fotos in einer streng kontrollierten Umgebung. Die Probanden trugen alle schwarze T-Shirts, hatten ihr Make-up entfernt und ihre Haare zurückgebunden. Die Fotos wurden an einer festen Position, in einem gut beleuchteten Raum und vor einem neutralen Hintergrund aufgenommen.

Die Bilder wurden dann von einem Gesichtserkennungsalgorithmus verarbeitet, der numerische „Gesichtsdeskriptoren“ extrahierte. Diese Deskriptoren kodieren Gesichtsmerkmale in eine computeranalysierbare Form. Und sie wurden verwendet, um die politische Orientierung der Teilnehmer mithilfe eines Modells vorherzusagen, das sie auf einer politischen Orientierungsskala abbildete.

KI kann die politische Ausrichtung besser einschätzen als Menschen

Die Ergebnisse? Sie sind großartig. Der Gesichtserkennungsalgorithmus konnte die politische Orientierung vorhersagen mit einem Korrelationskoeffizienten von 0,22. Obwohl diese Korrelation bescheiden ist, ist sie statistisch signifikant und legt nahe, dass einige stabile Gesichtsmerkmale unabhängig von anderen demografischen Faktoren mit der politischen Orientierung zusammenhängen können.

Aber das ist noch nicht alles. In einem zweiten Schritt ersetzten die Forscher den Algorithmus mit 1.026 menschlichen Bewertern, indem man sie bittet, die politische Orientierung anhand derselben standardisierten Bilder abzuschätzen. Überraschenderweise waren Menschen auch in der Lage, die politische Ausrichtung mit einer Genauigkeit vorherzusagen, die mit der des Algorithmus vergleichbar war. Mit einem Korrelationskoeffizienten von 0,21. Kurz gesagt, etwas weniger gut.

Schließlich in einer dritten Phase, wandten die Forscher das Modell auf eine Reihe von Bildern von Politikern an, um die Ergebnisse in einem realeren Szenario zu validieren. Auch hier war das Gesichtserkennungsmodell in der Lage, die politische Orientierung mit erheblicher Genauigkeit vorherzusagen. Dies zeigt, dass einige der prädiktiven Gesichtsmerkmale auch in vielfältigeren Bildern identifiziert werden können.

Zukünftige Auswirkungen: eine beispiellose Bedrohung

Die Ergebnisse dieser Studie werfen erhebliche Bedenken hinsichtlich des Datenschutzes auf. Die Gesichtserkennung kann ohne Zustimmung oder Wissen der Probanden eingesetzt werden.

Gesichtsbilder können leicht (und heimlich) von Strafverfolgungsbehörden aufgenommen oder aus digitalen oder traditionellen Archiven, einschließlich sozialen Netzwerken, Dating-Plattformen, Foto-Sharing-Sites und Regierungsdatenbanken, bezogen werden. Sie sind oft leicht zugänglich: Facebook- und LinkedIn-Profilfotos beispielsweise können von jedermann ohne deren Zustimmung oder Wissen eingesehen werden.

Daher sind die von der Gesichtserkennungstechnologie ausgehenden Datenschutzbedrohungen in vielerlei Hinsicht beispiellos. Und mit der zunehmenden Nutzung dieser Instrumente sowohl im öffentlichen als auch im privaten Sektor wird das Risiko von Missbrauch und Massenüberwachung immer realer.

Die Zukunft der Gesichtserkennung: Stimmrechte und Gesichtsrechte

Das Studium der Kosinski und Kollegen öffnet ein Fenster in eine Zukunft, in der Gesichtserkennungstechnologie genutzt werden könnte, um intime Aspekte unserer Identität, wie etwa die politische Orientierung, ohne unsere Zustimmung oder unser Wissen preiszugeben. Es wirft aber auch viele ethische Fragen und Herausforderungen auf.

Wie können wir die potenziellen Vorteile dieser Technologie, wie etwa die Verbesserung der Sicherheit oder die Personalisierung von Diensten, mit den Risiken für die Privatsphäre und die individuelle Freiheit in Einklang bringen? Wie können wir sicherstellen, dass diese Tools nicht für bestimmte Zwecke verwendet werden? diskriminierend oder unterdrückend, insbesondere gegenüber Minderheiten und schutzbedürftigen Gruppen?

Auf diese Fragen gibt es keine einfachen Antworten. Aber wir müssen so schnell wie möglich danach suchen, denn das Gesicht, das wir jeden Morgen im Spiegel sehen, ist nicht nur eine Reihe biometrischer Merkmale, die analysiert und klassifiziert werden müssen. Es ist das Spiegelbild unserer Menschlichkeit, unserer Individualität, unserer Gedanken- und Ausdrucksfreiheit.

Und das sind Werte, die kein noch so ausgefeilter Algorithmus jemals kontrollieren muss.