zweite der neueste Bericht der Vereinten Nationen zum libyschen Bürgerkrieg hat das zu Ende gehende Jahr zum ersten Mal gesehen, dass ein autonomes Waffensystem, ein Killerroboter, jemanden getötet hat. In der Zukunft könnten wir uns daran erinnern, dass es der Ausgangspunkt eines neuen Wettrüstens war, das uns sehr schaden könnte.

In den letzten Tagen (vom 13. bis 17. Dezember) La UN-Konvention über bestimmte konventionelle Waffen traf sich wie alle fünf Jahre zu diesem Thema. Seit 1983 hat diese Versammlung beschlossen, einige grausame Waffen wie Antipersonenminen zu beschränken. Diesmal diskutierte er über ein mögliches Verbot dieser autonomen Waffen. Und es wurde kein Konsens erreicht, um sie zu begrenzen.

Es könnte ein katastrophaler Fehler gewesen sein.

Autonome Waffensysteme sind Killerroboter. In diesem Beitrag werde ich sie immer so nennen: Killerroboter. Denn das ist es, was ich bin. Systeme mit Waffen, die alleine funktionieren können. Systeme, die für den Krieg gemacht sind, um Menschen zu töten. Weltregierungen investieren stark in diesen Trend.

Auf der anderen Seite natürlich humanitäre Organisationen (eine davon Stop The Killer Robots, Sie finden hier) werden damit verbracht, nach Regeln und Verboten für die Entwicklung dieser Waffen zu fragen. Und es geht ihnen gut. Wenn wir den Einsatz autonomer Waffen nicht einschränken, wird es sehr schlimm enden. Disruptive Technologien in diesem Bereich können alle militärischen Strategien destabilisieren und das Risiko präventiver Angriffe erhöhen. Einschließlich chemischer, biologischer, nuklearer.

Angesichts des Entwicklungstempos von Killerrobotern könnte das gerade beendete UN-Treffen eine der letzten Gelegenheiten um ein neues Wettrüsten zu vermeiden. Oder der letzte.

Es gibt vier Gefahren, die jedem offensichtlich erscheinen, wenn es um Killer-Robotersysteme geht.

Erstes Problem von Killerrobotern: Identifikation.

Werden autonome Waffen IMMER zwischen einem feindlichen Soldaten und einem Kind mit einer Spielzeugpistole unterscheiden können? Der Unterschied zwischen einem einzelnen menschlichen Fehler (der auch möglich ist) und der falschen Algorithmuseinstellung könnte das Problem in ein unglaubliches Ausmaß bringen. Ein autonomer Waffenexperte namens Paul Scharr verwendet eine Metapher: die eines defekten Maschinengewehrs, das auch dann weiter feuert, wenn Sie den Finger vom Abzug nehmen. Und schieße, bis die Munition aufgebraucht ist, denn es ist nur eine Maschine. Er weiß nicht, dass er einen Fehler macht.

Was immer die Leute sagen, Künstliche Intelligenz ist noch nicht mit einer eigenen Moral ausgestattet (und er wird es wahrscheinlich nie haben, er wird es nie lernen können).

Das Problem ist nicht nur das sogar eine KI ist falsch, zum Beispiel wenn es Asthma als Faktor erkennt was das Risiko einer Lungenentzündung verringert, oder wenn es farbige Menschen identifiziert wie Gorilla. Wenn es falsch ist, weiß derjenige, der es geschaffen hat, nicht, warum es falsch war, und weiß nicht, wie es korrigiert werden soll. Deshalb halte ich es für unmöglich, dass sich Killerroboter nach einem "moralischen" Kriterium irgendeiner Art entwickeln können.

Zweites Problem bei Killerrobotern: Low-End-Proliferation.

Die Streitkräfte, die autonome Waffen entwickeln, gehen davon aus, dass sie diese eindämmen und kontrollieren können. Haben Sie eine dümmere Idee als diese gehört? Wenn uns die Geschichte der Waffentechnik eines lehrt, dann nur eines: die Verbreitung von Waffen. Auch in diesem Fall es war sehr vorhersehbar.

Was in der Vergangenheit mit der Kalashinkov passiert ist, einem Sturmgewehr, das so zugänglich geworden ist, dass es in alle Hände gelangt, kann für Killerroboter wiederholt werden. Marktdruck kann zur Entwicklung autonomer Waffen führen, die effektiv, billig und praktisch unaufhaltbar sind. Vor allem: weit verbreitet. In den Händen von Regierungen, verrückten Pferden, organisierter Kriminalität oder terroristischen Gruppen.

Es kann sein, dass es schon passiert ist. Der Kargu-2, hergestellt von einem türkischen Rüstungsunternehmen, ist eine Mischung aus Drohne und Bombe. Es verfügt über künstliche Intelligenz, um Ziele zu finden und zu verfolgen. Er ist ein Killer-Roboter und hat bereits auf dem Schauplatz des libyschen Bürgerkriegs autonom agiert, um Menschen anzugreifen.

Drittes Problem von Killerrobotern: High-End-Proliferation.

Wenn wir dann an „High-End“-Risiken denken, kommen wir zu Zenit. Nationen könnten konkurrieren, um immer verheerendere Versionen autonomer Waffen zu entwickeln, einschließlich solcher, die in der Lage sind, chemische, biologische, radiologische und nukleare Waffen montieren . Die moralischen Gefahren einer eskalierenden Waffentödlichkeit würden durch den eskalierenden Waffengebrauch noch verstärkt.

Sicher, diese Killer-Roboter werden wahrscheinlich mit teuren kommen ethische Kontrolleure entwickelt, um Kollateralschäden zu minimieren, dem Mythos des "chirurgischen" Angriffs folgend. Ein gutes Zeug nur für die öffentliche Meinung, kurz gesagt. Die Wahrheit ist, dass autonome Waffen selbst die banalste Kosten-Nutzen-Analyse ändern werden, die man vor der Planung eines Krieges durchführt. Sie werden Würfel mit tödlichem Risiko sein, die mit weniger Sorge gewürfelt werden können.

Asymmetrische Kriege, die von Nationen ohne konkurrierende Technologien geführt werden, werden häufiger werden. Eine enorm weit verbreitete Instabilität.

Viertes und letztes Problem: die Kriegsgesetze

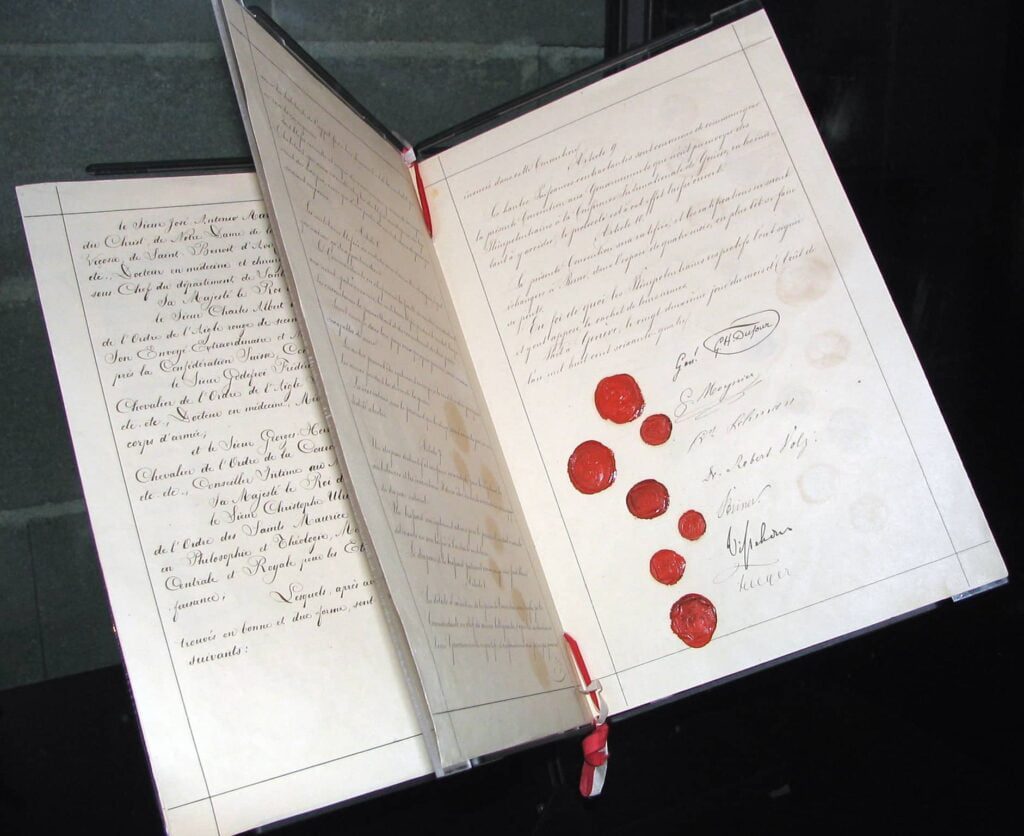

Killerroboter (wenn sie sich vermehren, ist es sicher) werden das letzte Palliativmittel der Menschheit gegen Kriegsverbrechen und Gräueltaten untergraben: internationale Kriegsgesetze. Diese Gesetze, kodifiziert in Verträgen, die von Anfang an beginnen Genfer Konvention, sie sind der schmale Grat, der den Krieg von etwas Schlimmerem trennt, das ich mir kaum vorstellen kann.

Das Kriegsrecht ist von grundlegender Bedeutung, weil es auch denjenigen, die einen Krieg führen, Verantwortung auferlegt. Slobodan Milosevic war Präsident eines Landes und musste sich für seine Taten verantworten. Er wurde vor dem Internationalen Strafgerichtshof der Vereinten Nationen für das ehemalige Jugoslawien angeklagt und er musste sich für das verantworten, was er tat.

Und nun? Ist es die Schuld eines Killerroboters, der Kriegsverbrechen begeht? Wer wird versucht? Die Waffe? Der Soldat? Die Kommandanten des Soldaten? Die Firma, die die Waffe hergestellt hat? NGOs und Völkerrechtsexperten befürchten, dass autonome Waffen ins Grab führen Haftungslücke .

Es muss nachgewiesen werden, dass ein Soldat mit einer in sich geschlossenen Waffe ein Verbrechen begangen hat. Dazu muss nachgewiesen werden, dass der Soldat eine schuldige Tat begangen hat und auch eine konkrete Absicht dazu hatte. Eine ziemlich komplizierte Dynamik in einer Welt voller Killerroboter.

Eine Welt voller Killerroboter ist eine Welt ohne Regeln, die sie auferlegen erhebliche menschliche Kontrolle auf Waffen. Es ist eine Welt, in der Kriegsverbrechen begangen werden, ohne dass Kriegsverbrecher zur Rechenschaft gezogen werden müssen. Die Struktur der Kriegsgesetze und ihr abschreckender Wert werden erheblich geschwächt.

Ein neues globales Wettrüsten

Stellen Sie sich vor, jeder kann so viel Kraft einsetzen, wie er möchte. Mit weniger Konsequenzen für alle. Stellen Sie sich einen Planeten vor, auf dem nationale und internationale Militärs, aufständische Gruppen und Terroristen zu Zeiten und Orten ihrer Wahl eine theoretisch unbegrenzte tödliche Streitmacht mit theoretisch null Risiko einsetzen können, ohne dass daraus eine rechtliche Haftung entsteht.