Untersuchungen zufolge sind die Wochen nach der Entlassung aus einer psychiatrischen Klinik eine notorisch schwierige Zeit für gebrechliche Menschen mit überdurchschnittlich hohen Selbstmordraten.

Jetzt könnten Fortschritte in der künstlichen Intelligenz die Spielregeln ändern und Psychiatern helfen, Selbstmordversuche vorherzusagen und rechtzeitig einzugreifen.

KI und psychische Gesundheit

Maschinelles Lernen, das Computeralgorithmen nutzt, um menschliches Verhalten besser vorherzusagen, ist ein schnell wachsendes Feld im Bereich der psychischen Gesundheit. Ein Wachstum, das mit dem von einhergeht Biosensoren Es ist in der Lage, die Stimmung einer Person in Echtzeit zu überwachen, indem es Musikauswahl, Gesichtsausdruck, Stimmton und sogar geschriebene Beiträge in sozialen Medien berücksichtigt.

Matthew K.Nock, Psychologe von Harvard und ein eifriger Erforscher des Phänomens Suizide hofft, diese Technologien zu einer Art Frühwarnsystem kombinieren zu können, das zum Einsatz kommt, wenn ein Risikopatient nach einem psychiatrischen Krankenhausaufenthalt entlassen wird.

Wie das Suizidsystem funktionieren könnte

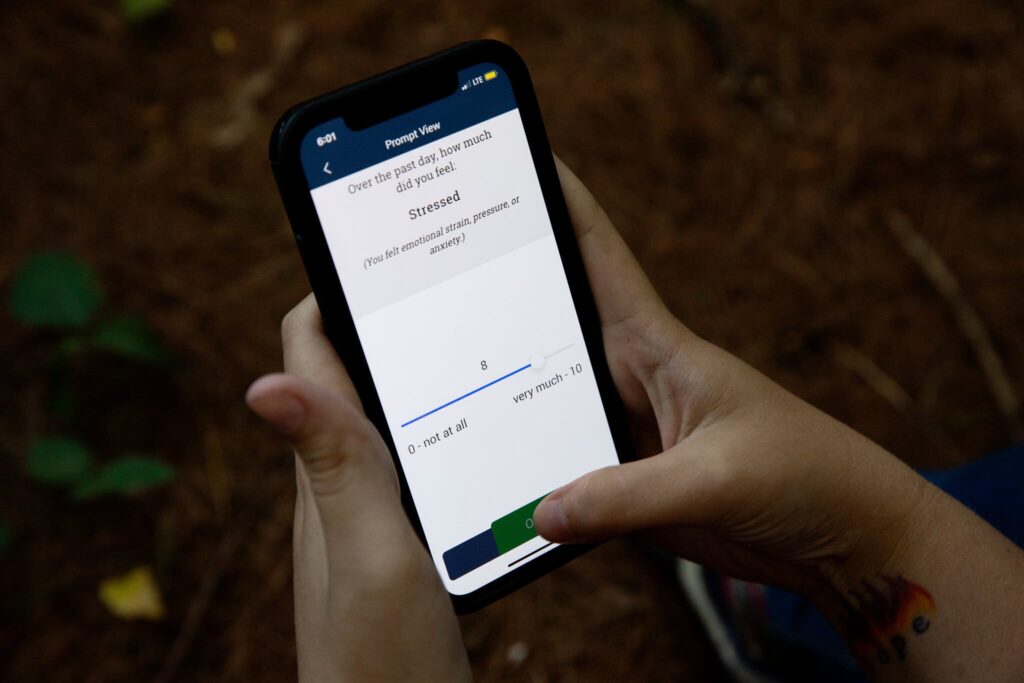

Ein Sensor signalisiert, dass der Schlaf eines Patienten gestört ist, das GPS zeigt an, dass er das Haus nicht verlässt. Der Beschleunigungsmesser auf seinem Handy zeigt, dass er sich viel bewegt, was auf Aufregung hindeutet. Auf den üblichen Fragebögen berichtet die Patientin von einer gedrückten Stimmung.

An diesem Punkt markiert der Algorithmus den Patienten. Und ein Arzt kommt durch einen Anruf oder eine Nachricht mit ihm in Kontakt.

Kann es funktionieren? Es ist nicht leicht vorherzusagen. Es gibt mehrere Gründe, daran zu zweifeln, dass ein Algorithmus jemals diese Genauigkeit erreichen wird. Selbst bei Menschen mit dem höchsten Risiko ist Selbstmord ein so seltenes Ereignis, dass jeder Versuch einer Vorhersage zu falsch positiven Ergebnissen führen kann, mit Interventionen bei Personen, die ihn nicht benötigen. Und andererseits würden alle falschen Negative ein ethisches Gewicht auf die rechtliche Verantwortung für das Unterlassen einer Intervention haben.

Suizidprävention braucht Mut

Um die künstliche Intelligenz zu perfektionieren, sind granulare Langzeitdaten von einer großen Anzahl von Menschen erforderlich, und sie sind schwer zu erhalten, da Selbstmord, so schrecklich er auch ist, glücklicherweise ein seltenes Ereignis ist. Ganz zu schweigen von der Tatsache, dass die für die Überwachung erforderlichen Daten enorme Datenschutzprobleme aufwerfen, außerdem für das Leben bereits gefährdeter Personen.

Doch Nock gibt nicht auf. Es muss etwas getan werden und Mut ist gefragt. „Bei allem Respekt vor denen, die diese Arbeit seit Jahrzehnten leisten, haben wir in einem Jahrhundert nichts darüber gelernt, wie man suizidgefährdete Menschen erkennt und wie man eingreift“, sagt er.

Die Suizidrate ist heute genauso hoch wie vor 100 Jahren. Also, es muss ehrlich gesagt werden, wir verbessern uns nicht.

Matthew K.Nock

Eine schwierige Aufgabe

Für einen Psychiater gibt es nichts Beunruhigenderes, als suizidgefährdete Patienten unbeaufsichtigt und zu Hause zu betreuen. Es handelt sich um eine sehr komplizierte „Grauzone“. Mit zunehmender Erfahrung wird immer klarer, dass Selbstmordgedanken ohne Vorwarnung kommen und gehen können.

Aus diesem Grund greifen immer mehr fortschrittliche Gesundheitssysteme auf maschinelles Lernen zurück, um voranzukommen. Algorithmen, die auf großen Datensätzen aus elektronischen Gesundheitsakten und zahlreichen anderen Faktoren basieren, werden verwendet, um Patienten einen Risikowert zuzuordnen, wobei Personen mit außergewöhnlich hohem Risiko stärker berücksichtigt werden.

Darüber hinaus scheinen sich die Algorithmen als genauer erwiesen zu haben als die "traditionellen" Methoden, die seit 50 Jahren immer gleich sind, so a Forschung 2017. Ab 2017 ist die Abteilung für Veteranenangelegenheiten in den USA verwendet es einen Algorithmus für melden 0,1 % der Veteranen mit dem höchsten Risiko von Selbstmord.

Wir sprechen von einigen tausend Patienten bei einer Bevölkerung von sechs Millionen.

Ergebnis? Die eingeschriebenen Patienten zu diesem Programm Sie waren 5% weniger wahrscheinlich, Selbstmord zu versuchen. Ein Tropfen auf den heißen Stein, der an den Gesamtraten nichts ändert. Der Eindruck ist, dass wir angefangen haben, Dinge zu tun, die noch nie zuvor getan wurden, aber wir haben noch nicht gefunden, wonach wir suchen.

Auf der Suche nach einem Muster

„Es ist nicht leicht, sie zu erkennen“, sagt er Nick Allen, Direktor des Center for Digital Mental Health an der University of Oregon. Allen half bei der Entwicklung OHREN, eine App, die die Stimmung anhand von Faktoren wie Musikauswahl, Gesichtsausdruck und verbalem Ton verfolgt.

Von dort könnte ein Wendepunkt kommen. Und zurück zu Dr. Nock.

Letzten August rief ein Datenwissenschaftler an Adam Bär Er saß vor einem Monitor in Dr. Nocks Labor und starrte auf Zickzack-Diagramme des Stressniveaus eines Patienten im Laufe dieser Woche. Er suchte nach einem Muster: etwas, das sich wiederholt und es Ihnen ermöglichen kann, jemanden im Voraus zu identifizieren, der einen Selbstmordversuch unternimmt.

Zu diesem Zweck untersuchte Bear den ganzen Sommer lang die Daten von 571 Patienten, die sich nach Selbstmordgedanken oder -versuchen zu einer Überwachung bereit erklärten. Während des sechsmonatigen Programms nahmen sich zwei von ihnen das Leben, 100 versuchten es.

Zusammenfassend: Dies ist das größte Reservoir an Informationen, das jemals über das tägliche Leben von Menschen gesammelt wurde, die mit Suizidgedanken zu kämpfen haben.

Was sind die Anzeichen für einen möglichen Suizid?

Nocks Team interessiert sich sehr für die Tage vor den Suizidversuchen, da in dieser Zeit gehandelt werden könnte. Einige Anzeichen sind bereits aufgetaucht: Obwohl sich Suizidimpulse in der Zeit vor einem Versuch oft nicht ändern, scheint die Fähigkeit, diesen Impulsen zu widerstehen, abzunehmen. Mit einem wiederkehrenden Hinweis, Schlafentzug, der viel dazu beizutragen scheint.

Ein kleines, aber sehr wichtiges Signal, das uns vielleicht ermutigt, darauf zu bestehen. Menschen mit Suizidgedanken konnten wir noch nie beobachten, weil es zum einen anders ist, als Menschen mit Herzerkrankungen zu beobachten.

"Die Psychologie", sagt Nock, "ist nicht so weit wie die anderen Wissenschaften, weil ihr nicht viele Werkzeuge zur Verfügung standen."

Mit dem Aufkommen von Smartphones und tragbaren Biosensoren haben wir jedoch die Möglichkeit, so viele Daten zu sammeln, um diesen Nachteil auszugleichen.

Ein gesichtsloser Engel

Ein Dilemma, mit dem die Forscher in der laufenden Studie konfrontiert waren, war, was zu tun ist, wenn die Teilnehmer einen starken Wunsch zeigten, sich selbst zu schaden. Dr. Nock entschied, dass sie eingreifen sollten, auch wenn dies die Forschung verlangsamte (und für einige Patienten durchkreuzte).

„Das hat einen Nachteil“, sagt der Wissenschaftler, „denn paradoxerweise führt dies zu weniger Selbstmorden und damit zu einer geringeren Chance, ein Signal zu finden.“ Aber was wäre, wenn dieser Patient mein Sohn wäre?“

Dadurch ist die Studie auch zu einer Anti-Suizid-Task Force geworden, und die Interventionen sind zur Routine im Laboralltag geworden. Wenn ein Patient während der Überwachung einen kritischen Moment erlebte, erhielt er innerhalb von 15 Minuten einen Anruf von einem der Ermittler.

„Wir sind eine Art gesichtslose Person, daher gibt es weniger Unbehagen“, sagt er Narise Ramlal, ein wissenschaftlicher Mitarbeiter im Labor. Aber Dr. Nock möchte verstehen, ob sich digitale Interventionen als wirksamer erweisen könnten.

„Viele Menschen möchten nicht, dass ein Mensch Kontakt zu ihnen aufnimmt, wenn sie einem hohen Risiko ausgesetzt sind“, sagte er. „Ich möchte nicht sagen, dass wir Menschen durch Maschinen ersetzen werden, aber manchmal können sie viel effizienter sein als wir jetzt.“

Eine emblematische Geschichte

Im März ist der 39-Jährige Katelin Cruz Sie verließ ihren letzten psychiatrischen Krankenhausaufenthalt mit viel Entschlossenheit, aber auch Zerbrechlichkeit und Angst. Dafür entschloss er sich, an der Überwachung teilzunehmen. Sie studierte Krankenpflege, als eine Reihe psychischer Krisen ihr Leben erschütterten.

Es war etwa 21 Uhr, ein paar Wochen nach Beginn der sechsmonatigen Studie, als auf seinem Telefon eine Frage auftauchte: „Wie stark ist im Moment Ihr Wunsch, sich umzubringen?“

Ohne nachzudenken, berührte Katelin den Bildschirm: 10. Ein paar Sekunden später wurde sie gebeten, zwischen zwei Aussagen zu wählen: „Heute werde ich mich definitiv nicht umbringen“ und „Heute werde ich mich sicher umbringen“. Er wählte den zweiten Satz.

Fünfzehn Minuten später klingelte sein Telefon. Sie war Mitglied der Suchgruppe, die sie rief, hatte bereits die Polizei alarmiert und Katelin in der Leitung gehalten, bis die Polizei an ihre Tür klopfte: Kurz darauf hatte Katelin einen emotionalen Zusammenbruch und wurde ohnmächtig.

Ob es das Problem löst oder nicht, Suizidtechnologie kann bereits etwas: dabei sein.

Katalin begann umgehend auf die sechs „Aufforderungen“ zu reagieren, die sie jeden Tag erhielt, wenn die App auf ihrem Telefon sie zu ihren Selbstmordgedanken befragte. Benachrichtigungen? Zuerst aufdringlich, dann beruhigend.

„Ich fühlte mich nicht länger ignoriert“, sagt sie. „Jemanden zu haben, der weiß, wie ich mich fühle, entlastet mich ein wenig.“ Er glaubt, dass Technologie (ihre „Neutralität“, ihr „Mangel an Urteilsvermögen“) es einfacher macht, um Hilfe zu bitten. „Ich denke, es ist fast einfacher, einem Computer die Wahrheit zu sagen“, sagte er.

Viele Experten meinen, es könnte auch umgekehrt sein: Krisenpatienten sind geschickt darin, Telefonisten über ihren Gesundheitszustand zu täuschen, und mit einem Computer ist es auch einfacher zu lügen. Viel bessere Menschen: eine Selbsthilfegruppe, die sich jede Woche trifft, ein Stuhlkreis, ein Netzwerk aus Freunden, Familie und Ärzten.

Nicht jeder hat es. In Italien kann die Warteliste für einen Therapeuten in einem öffentlichen Zentrum für psychische Gesundheit bis zu drei Monate betragen. In den USA sind es acht Monate.

Und sag mir, dass du nicht sterben willst

Letzte Woche, am Ende der sechsmonatigen klinischen Studie, füllte Katalina ihren letzten Fragebogen mit einiger Traurigkeit aus. Sie wird das Gefühl vermissen, dass jemand sie aus der Ferne durch ein Gerät beobachtet, auch wenn es jemand ohne Gesicht ist.

Es gibt Zeiten, sehr wenige, in denen ein „großer Bruder“ dafür sorgen kann, dass Sie sich besser fühlen. Hättest du das jemals gesagt?

„Ehrlich gesagt fühlte ich mich etwas sicherer, weil ich wusste, dass sich jemand genug darum kümmerte, diese Daten jeden Tag zu lesen“, sagt Katalina.

Und ich glaube ihr.

Wenn Sie Selbstmord erwägen, rufen Sie an 112 oder sprechen Sie mit der Telefonnummer: täglich von 10 bis 24 Uhr unter der Nummer 02 23272327 oder mit einem kostenlosen Webcall auf www.telefonoamico.net