Gestern traf sich OpenAI mit dem italienischen Garanten für den Schutz personenbezogener Daten, um die Datenschutzbedenken anzusprechen, die zur vorübergehenden Sperrung von ChatGPT in Italien geführt haben. Der Chatbot mit künstlicher Intelligenz wurde von demselben amerikanischen Unternehmen als Vorsichtsmaßnahme blockiert, nachdem die Nachrichten und Zahlungsinformationen einiger Benutzer bei einem (katastrophalen) Datenverstoß am 20. März an andere weitergegeben wurden.

Dies ist der erste Fall, in dem eine Demokratie eine KI-Plattform dieser Größenordnung blockiert. Eine Operation an sich nicht ohne Streit und Schatten. In jedem Fall hat OpenAI versprochen, Schritte vorzuschlagen, um die Bedenken auszuräumen, obwohl sie noch nicht vollständig detailliert sind. Die Nachricht kommt direkt in einer Notiz auf derselben offiziellen Website der italienischen Behörde.

Lassen Sie uns reden

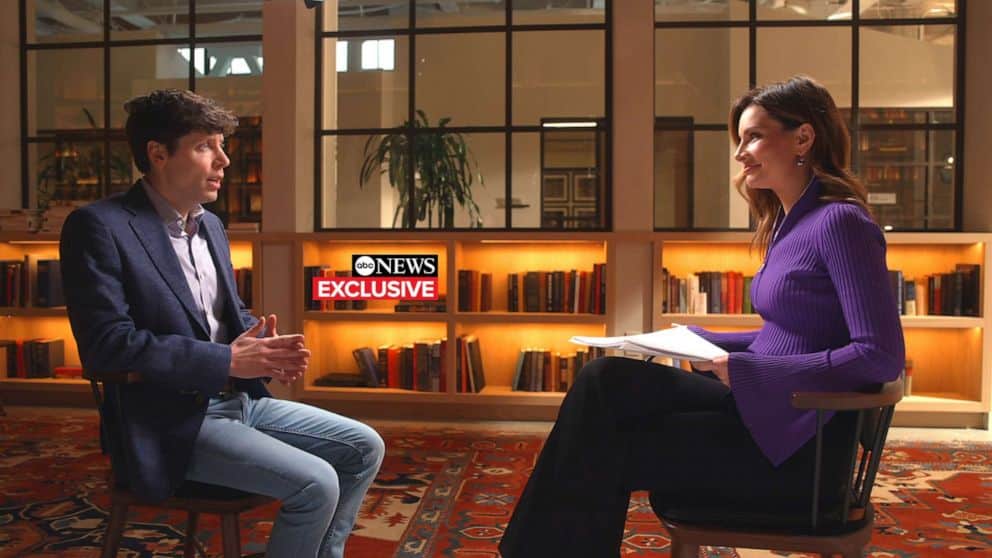

In dem gestrigen Videoanruf zwischen den Beauftragten des Garanten und den Managern von OpenAI, einschließlich des CEO Sam Altman, haben wir die erste wirkliche Entspannung in dieser ganzen Angelegenheit erlebt, die (ich mache keine Witze) Unternehmen und Einzelpersonen in Atem hält (und die Maus über VPNs, deren Registrierungen in die Höhe geschossen sind). Altmans Unternehmen hat seinerseits versprochen, Maßnahmen zur Lösung der Bedenken vorzulegen. Der Garant betonte jedoch, wie wichtig es sei, die strengen Datenschutzbestimmungen der 27 EU-Länder einzuhalten. Insbesondere stellte er die rechtliche Grundlage für die Erhebung riesiger Datenmengen zum Trainieren von Algorithmen in Frage ChatGPT und äußerte Bedenken, dass das System falsche Informationen über Einzelpersonen generieren könnte.

Das Clearing des Garanten

Der eigentliche Sinn der ganzen Angelegenheit war jedoch die ausgestreckte Hand des Bürgen, die wahrscheinlich auf die starke Uneinigkeit verschiedener Sektoren (und vieler Nutzer) zurückzuführen ist. Die Kommissare brachten sehr deutlich ihren Wunsch zum Ausdruck, die Entwicklung der KI in Italien nicht zu behindern. Und das kann einen „glücklichen“ Ausgang der ganzen Angelegenheit nur ausschließen.

Was passiert jetzt?

OpenAI sagte, es arbeite daran, personenbezogene Daten nach Möglichkeit aus Trainingsdaten zu entfernen, seine Modelle so einzustellen, dass Anfragen von Privatpersonen nach personenbezogenen Daten abgelehnt werden, und auf Anfragen zur Löschung personenbezogener Daten aus seinen Systemen zu reagieren. Der Fall ist also abgeschlossen? NEIN. In Italien besteht, wie erwähnt, der Eindruck, dass es zu einer Wiedereröffnung des Systems kommen wird. Generell jedoch „wärmen“ die Behörden ihre Motoren auf, um die Lücke zu schließen und zu versuchen, den Sektor zu regulieren.

Andere Regulierungsbehörden in Europa und anderswo begannen nach der Maßnahme Italiens, aufmerksamer zu werden. Die irische Datenschutzkommission sagte, sie stehe „in Kontakt mit der italienischen Aufsichtsbehörde, um die Grundlage ihrer Maßnahmen zu verstehen und sich mit allen EU-Datenschutzbehörden in dieser Angelegenheit abzustimmen“. Frankreichs Datenschutzbehörde CNIL, sagte dass es eine Untersuchung eingeleitet hat, nachdem es zwei Beschwerden über ChatGPT erhalten hatte. Auch der Datenschutzbeauftragte Kanadas eine Untersuchung eingeleitet auf OpenAI. Und er tat dies, nachdem er eine Beschwerde über die angebliche „Erhebung, Nutzung und Weitergabe personenbezogener Daten ohne Einwilligung“ erhalten hatte.

Andererseits steht die KI-Reise gerade erst am Anfang, oder?