Forscher der University of California in San Diego haben kürzlich ein maschinelles Lernsystem entwickelt, das vorhersagt, was Vögel singen werden.

Wenn Sie keine großartigen praktischen Möglichkeiten finden, möchte ich Ihnen zunächst sagen, dass eine prädiktive Sprachsynthese in Echtzeit für Stimmprothesen bereits eine großartige Sache wäre. Aber die Implikationen des Verständnisses des Vogelgesangs könnten noch viel weiter gehen.

Vogelgesang, eine extrem gegliederte Welt

Vogelgesang ist eine komplexe Form der Kommunikation, die Rhythmus, Ton und vor allem erlerntes Verhalten beinhaltet.

Laut den Forschern ist es ein wertvoller Schritt auf dem Weg, biologische menschliche Laute zu ersetzen, wenn man einer KI beibringt, Vogelgesang zu verstehen (und genug aufzubauen, um vorherzusehen).

Motorprothesen nutzten Primaten als Tiermodell. Für Stimmprothesen gibt es kein vergleichbares Modell. Dies ist vielleicht der Grund, warum diese in Bezug auf die neuronale Schnittstellentechnologie, die Gehirnabdeckung und das Design von Verhaltensstudien begrenzter sind.

Es ist nicht leicht, über Vogelgezwitscher nachzudenken, aber es ist ein wichtiger Schritt

Singvögel sind ein interessantes Modell für erlerntes komplexes Stimmverhalten. Vogelgesang hat eine Reihe einzigartiger Ähnlichkeiten mit der menschlichen Sprache. Das Studium hat bereits hervorragende allgemeine Informationen über die Mechanismen und Schaltkreise geliefert, die dem Lernen, Ausführen und Erhalten der stimmmotorischen Fähigkeiten zugrunde liegen.

Vokalisationen in Echtzeit zu übersetzen ist jedoch keine leichte Herausforderung. Gegenwärtige Systeme sind im Vergleich zu unseren natürlichen Gedanken-Sprache-Mustern immer noch langsam.

Denken Sie darüber nach, denn es ist cool: Moderne Systeme zur Verarbeitung natürlicher Sprache haben immer noch Mühe, mit dem menschlichen Denken Schritt zu halten.

Für ein Auto sind wir noch zu schnell

Bei der Interaktion mit unserem Google Assistant oder Alexa gibt es oft eine längere Pause, als wir es von einer echten Person erwarten würden. Dies liegt daran, dass künstliche Intelligenz unsere Sprache verarbeitet, die Bedeutung jedes Wortes in Bezug auf seine Fähigkeiten bestimmt und dann entdeckt, auf welche Reaktionen oder Programme wir zugreifen müssen, um darauf zu reagieren.

Es ist natürlich schon überraschend, dass diese Cloud-basierten Systeme mit dieser Geschwindigkeit laufen. Aber sie sind immer noch nicht gut genug, um eine Echtzeitschnittstelle zu schaffen, die es Sprachlosen ermöglicht, in Gedankengeschwindigkeit zu sprechen.

Forschung zum Vogelgesang

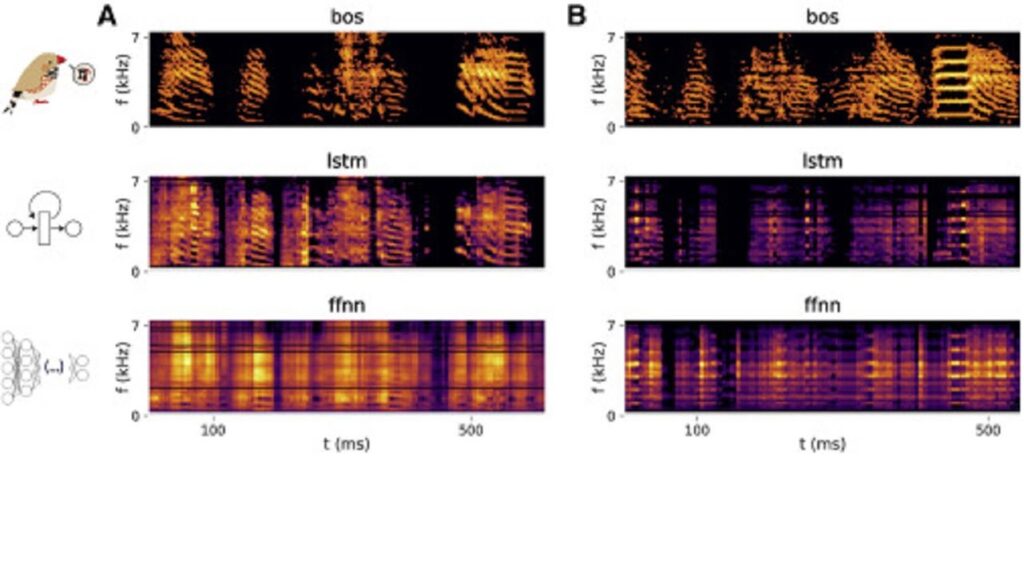

Zuerst implantierte das Team Elektroden in ein Dutzend Vogelgehirne (Zebrafinken) und begann dann, die Gehirnaktivität während des Vogelgesangs aufzuzeichnen.

Aber es reicht nicht, einer künstlichen Intelligenz beizubringen, die neuronale Aktivität von Vögeln während ihres Gesangs zu erkennen: Selbst das Gehirn eines Vogels ist zu komplex, um die Funktionsweise der Kommunikation zwischen seinen Neuronen vollständig abzubilden.

Dafür trainierten die Forscher ein weiteres System, um Songs in Echtzeit auf erkennbare Muster zu reduzieren, mit denen künstliche Intelligenz arbeiten kann.

Es ist sehr interessant, weil es eine Lösung für ein noch offenes Problem bietet.

Die Echtzeit-Vogelgesang-Verarbeitung ist beeindruckend und diese Ergebnisse mit menschlicher Sprache zu replizieren, wäre historisch.

Aber dieser erste Job ist noch nicht fertig. Und es ist noch nicht an andere Sprachsysteme anpassbar. Es funktioniert möglicherweise nicht über Vogelgezwitscher hinaus.

Aber wenn es so wäre, wäre es einer der ersten gigantischen Technologiesprünge für Gehirn-Computer-Schnittstellen seit dem Wiederaufleben des Deep Learning im Jahr 2014.