Nvidia, der GPU-Gigant, der die Welt der künstlichen Intelligenz erobert hat, zeigt keine Anzeichen einer Verlangsamung. Andererseits, mit der Präsentation des neuen Blackwell B200 GPU und der „Superchip“ GB200 scheinen darauf bedacht zu sein, seinen Vorsprung gegenüber der Konkurrenz weiter auszubauen.

Diese Monster an Rechenleistung, mit bis zu 30-mal mehr Leistung als der bereits beeindruckende H100versprechen, die Horizonte der KI neu zu definieren und Nvidias Dominanz in einem zunehmend strategischen und wettbewerbsorientierten Sektor zu festigen.

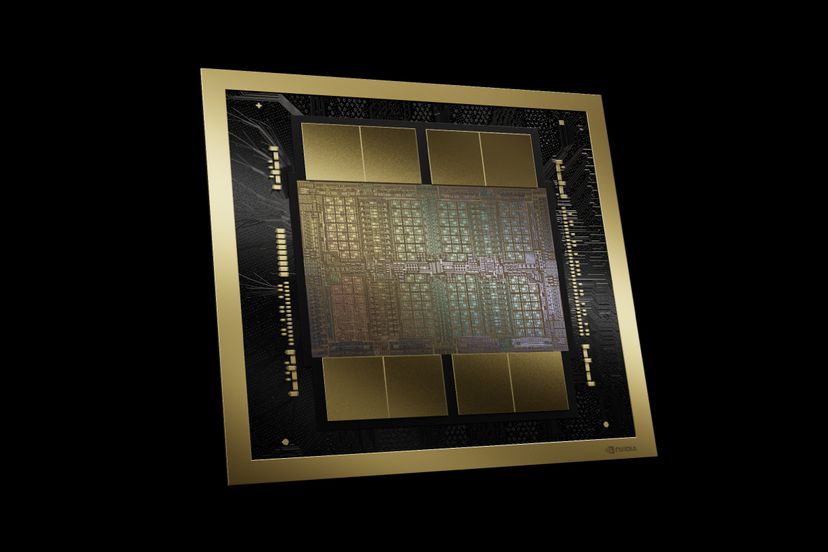

Blackwell B200, 208 Milliarden Transistoren und 20 Petaflops reine Leistung

Die Zahlen lassen einen schwindlig werden. Die neue B200-GPU packt satte 208 Milliarden Transistoren (ja, Sie haben richtig gelesen, Milliarden) in einen einzigen Chip und setzt bis zu 20 Petaflops 4-Bit-Gleitkomma-Rechenleistung (FP4) frei. Um Ihnen eine Vorstellung zu geben: Dies ist eine Kraft, die mit der von vergleichbar ist 20 Millionen High-End-Laptops. Und das alles auf einem einzigen Chip in der Größe einer Postkarte.

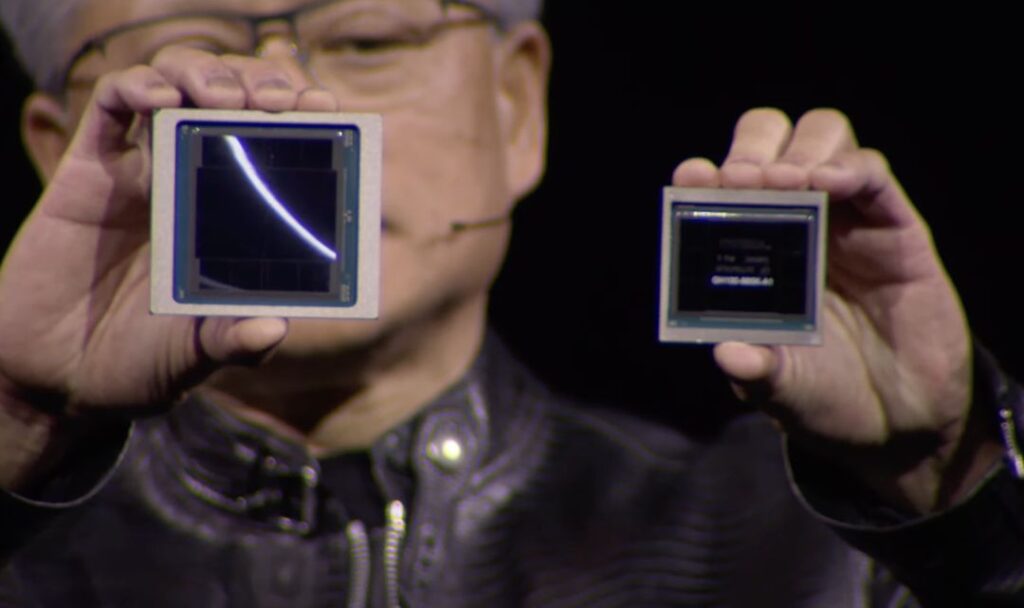

Aber Nvidias wahres Ass im Ärmel ist Blackwell GB200, ein „Superchip“, der zwei B200-GPUs mit einer Grace-CPU in einem einzigen Paket vereint. Dieses 30-Petaflops-Biest verspricht eine bis zu 30-fache Leistung des H100 bei LLM-Inferenzaufgaben (Large Language Model) bei einer Reduzierung der Kosten und des Stromverbrauchs um 25 %. In zwei Worten: mehr Leistung, weniger Kosten, weniger Umweltbelastung. Ja, es waren 7 Wörter.

Wenn ein Chip nicht ausreicht, kümmert sich die „Transformator-Engine“ darum

Wie bringt Nvidia all diese Leistung zur Geltung? Eines der Geheimnisse liegt in der „Transformer Engine“ der zweiten Generation: einer dedizierten Architektur, die die Rechenkapazität verdoppelt und mehr Neuronen auf weniger Raum platziert, was zu immer größeren und leistungsfähigeren neuronalen Netzen führt.

Was passiert, wenn Sie Dutzende oder Hunderte dieser Chips in einem Server zusammenfassen? Bis zu 576 GPUs können mit einer bidirektionalen Bandbreite von 1,8 Terabyte pro Sekunde miteinander „sprechen“. In drei Worten (diesmal wirklich, ich schwöre): extremes paralleles Rechnen.

Vom Chip zum Supercomputer ist es ein kurzer Schritt

Wenn Sie eine Vorstellung davon haben möchten, was wir bald sehen werden: Die Systeme, die von diesen Blackwells angetrieben werden, werden in der Lage sein, Modelle mit 27 Billionen Parametern zu trainieren. GPT-4 verfügt über „nur“ 1,7 Billionen.

Nvidia scheint die gesamte KI-Welt vor eine Herausforderung zu stellen: Wollen Sie schnell sein? Folgen Sie uns. Und die großen Cloud-Player scheinen die Botschaft verstanden zu haben: Amazon, Google, Microsoft und Oracle stehen bereits Schlange, um diese Schmuckstücke in ihren Diensten anzubieten. Ein Zeichen dafür, dass der Hunger nach Rechenleistung größer denn je ist.

Zerstört Nvidia mit Blackwell den Markt?

Es gibt diejenigen, die angesichts dieser übermäßigen Macht von Nvidia die Nase rümpfen, wodurch die Gefahr besteht, dass ein faktisches Monopol in einem Schlüsselsektor wie der künstlichen Intelligenz entsteht. Es ist gut, die Frage zu stellen. Es gibt Befürchtungen, dass dieser Wettlauf um „größer, schneller, leistungsfähiger“ zu einer unkontrollierten Entwicklung immer komplexerer und unvorhersehbarerer KI-Systeme führen könnte. Auch das ist eine berechtigte Frage.

Denn jenseits dieser Fragezeichen hat Nvidia mit Blackwell und GB200 bewiesen, dass das Unternehmen auf dem Beschleuniger der Innovation steht. Schlecht. Und dass ich nicht die Absicht habe, es zu entfernen.

Ob es Ihnen gefällt oder nicht, die Zukunft der KI spricht zunehmend die Sprache der GPUs. Und er hat das schlaue Gesicht von Jensen Huang.